,吕子奇,王卫东,张康辉,吕海梅

,吕子奇,王卫东,张康辉,吕海梅煤矸石快速高效的分离是提高煤质的主要途径,将推动洁净煤技术的发展[1]。目前γ射线透射法和X射线透射法煤矸分选技术比较成熟,但存在辐射危害,应用上受到了限制[2]。将激光三维扫描测量体积与动态称重相结合,通过煤与矸石密度差实现煤矸的分离也是新兴的方法之一,但该方法误差较大[3]。

近年来计算机视觉技术成为矿物识别的研究热点[4]。利用煤与矸石图像的空间域信息(如灰度和纹理),在特定环境下可以进行有效的煤矸识别,但识别稳定性有待提高[5-8]。利用支持向量机和人工神经网络建立分类模型,对提取到的煤矸图像特征向量进行分类,可有效提高识别的准确率和稳定性[9-12]。

利用图像处理技术人工设计和提取特征值,结合经典机器学习算法,一定条件下能够解决煤与矸石分选问题,但该方法中的合理有效的特征值难找,且模型的泛化能力较差。卷积神经网络(Convolutional Neural Network,CNN)相较于其他经典机器学习算法的图像识别模式,其最大特点为网络训练采用端到端的训练方式,即可以直接以图像本身作为输入,通过深度网络自动分层提取图像特征,实现图像的分类与识别工作[13]。文献[14]基于vgg_16网络和迁移学习的思想,建立了煤与矸石识别模型,但样本集较小,仅有240张。文献[15]设计了改进的LeNet-5网络,对选煤厂采集的20 000张非生产状态下煤与矸石的图片进行了训练,识别率为95.88%。

现阶段关于煤矸图像识别研究的不足之处在于:① 研究均在实验室理想条件下进行,图像样本集来源为实验室拍摄或选煤厂非生产状态下拍摄。没有考虑实际生产时煤与矸石相互污染夹杂的问题,且生产环境阴暗潮湿,会大大增加煤与矸石的图像识别难度。文献[16-17]的研究证明了图像采集的环境和煤矸物料的表面状态会严重影响识别结果;② 目前研究所利用的深度网络模型参数众多,模型复杂度高、计算量大,较难部署在硬件资源有限的嵌入式设备中[18]。如何利用权值量化[19]、知识蒸馏[20]和模型剪枝[18]等深度网络模型压缩和加速的方法轻量化煤矸分选问题中模型,对于探究深度学习在处理实际问题时的作用机理、扩展深度学习在矿物加工领域的应用方向具有重要意义。

笔者以生产状态下现场采集的煤与矸石图像为输入,基于多种CNN结构建立了煤矸识别模型,分析了各网络结构的训练曲线与测试结果。在此基础上,引入模型剪枝对部分经典深度网络结构进行了轻量化处理,定量研究了结构轻量化对煤矸识别的影响。最后基于热力图可视化方法,揭示了基于CNN建立的煤矸图像识别模型的分类依据。

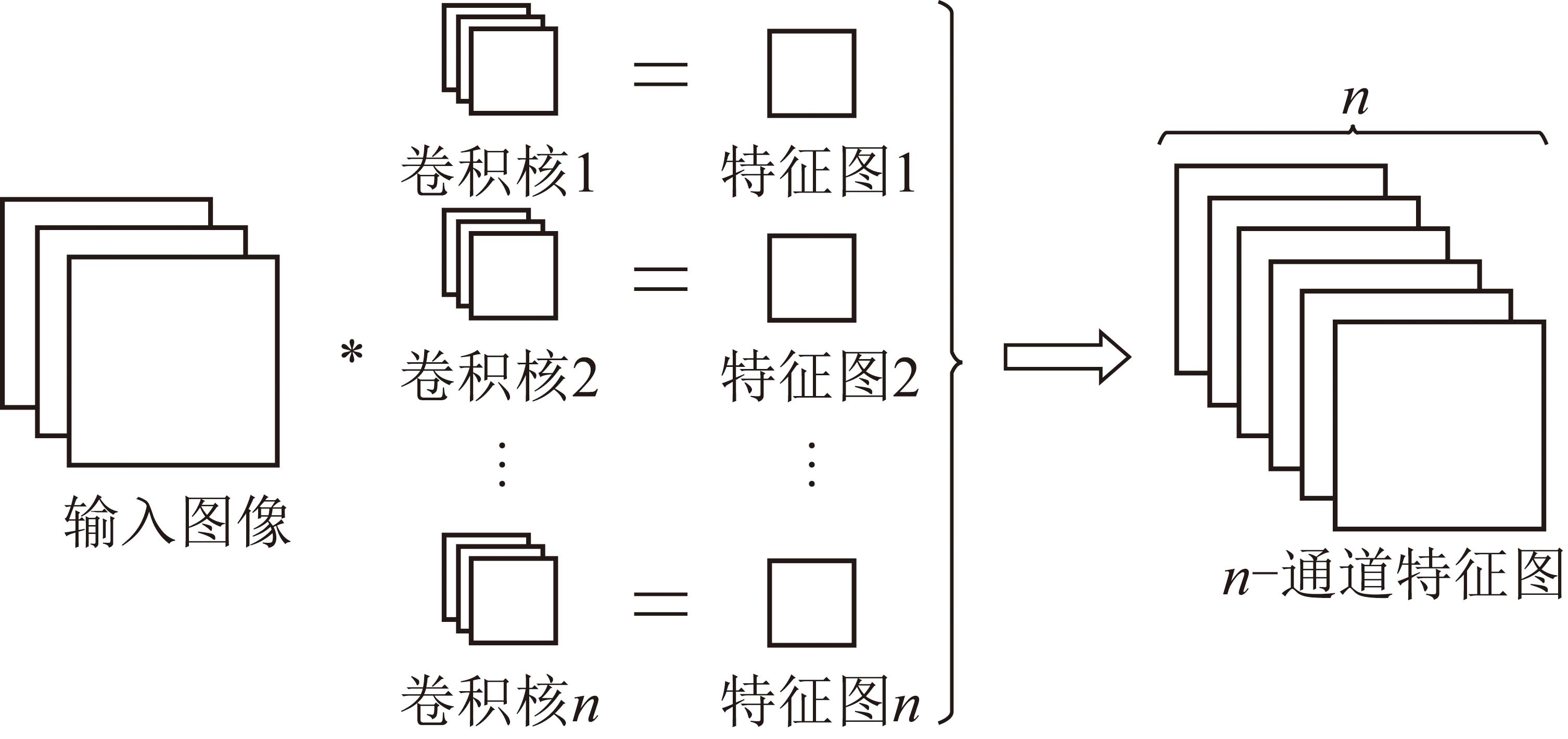

卷积层作为CNN的核心部分,通过卷积核(kernel)进行卷积运算,完成特征提取,然后利用激活函数构建特征映射关系[21]。一层卷积层内包含多个不同的卷积核,每个卷积核均采用滑动窗口的方式遍历输入图片,得到多通道特征图,运算过程如图1所示。

图1 卷积核提取多通道特征过程示意

Fig.1 Schematic diagram of multi-channel feature extraction with convolution kernel

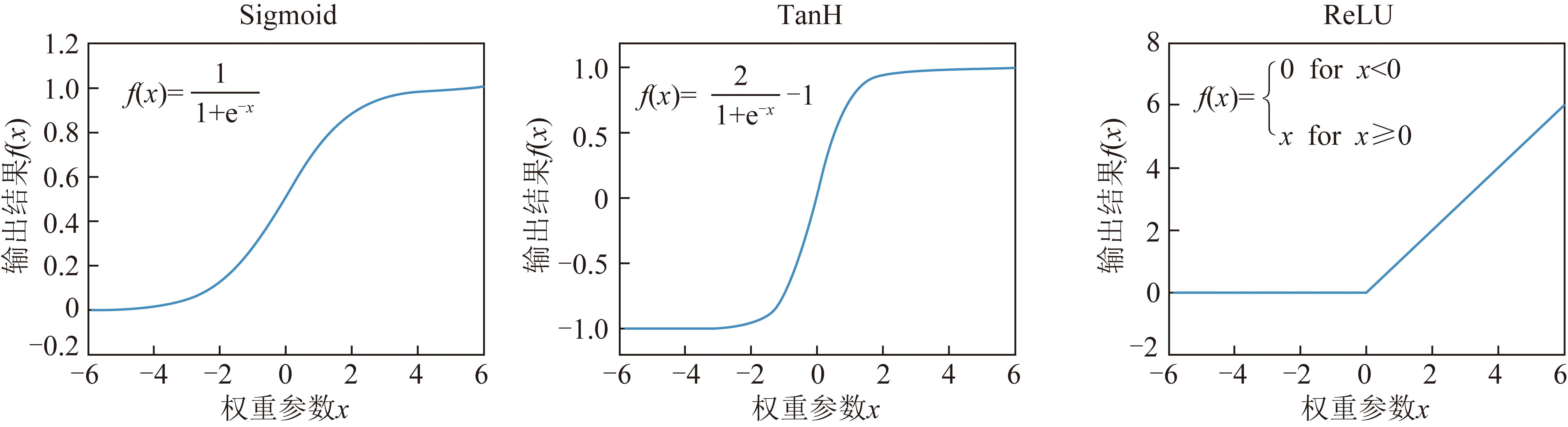

激活函数用于引入非线性变化,从而提升网络对任意函数的逼近能力,常用的激活函数包括Sigmoid函数、TanH函数和ReLU函数等,各激活函数曲线如图2所示。

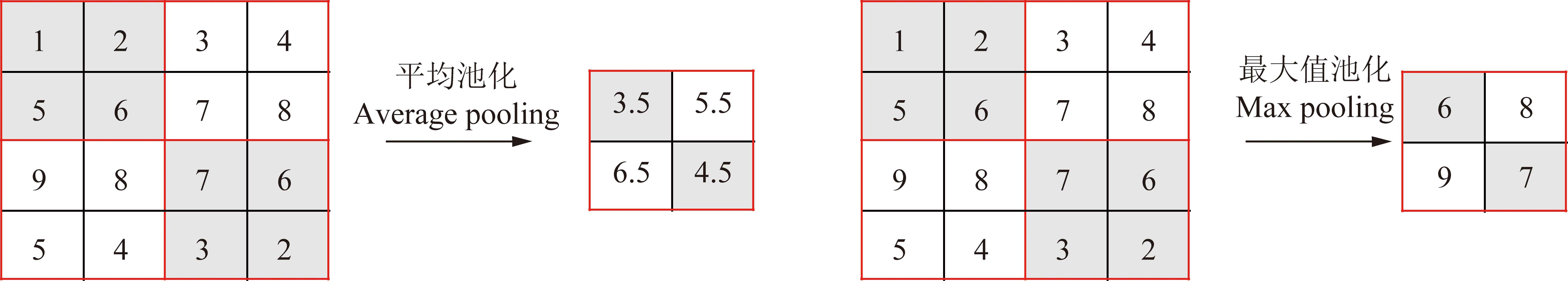

池化层的作用是在保证信息有效性的基础上,通过减少激活函数输出的数据量来提升网络的训练速度[21]。常用的池化方法包括最大值池化(max pooling)和平均池化(average pooling),其运算过程如图3所示。

图2 激活函数

Fig.2 Activation functions

图3 典型池化过程计算示意

Fig.3 Typical pooling process calculation

全连接层结构和一般神经网络的隐藏层相同,即每一层的神经元节点都与前一层的神经元节点相连接,主要用于完成对卷积和池化过程后输出特征的压缩与分类。但由于全连接层最后输出的分类结果并非概率分布,所以需要进行Softmax回归处理,以便网络训练时损失函数的运算。设原网络全连接层输出为y1,y2,…,yn,则处理后的输出为

![]()

(1)

早期经典的CNN基本由上述层结构通过级联组成,如LeNet[22],AlexNet[13],VGG Net[23]和ResNet[23]等。由于CNN自动提取图像特征的能力很大程度依托于网络宽度与深度,所以采用更深层更大规模的网络结构往往可以取得更好的效果,但模型的存储空间与运算速度问题严重影响了模型的效率。为了提升网络运算效率,在尽可能不损失精度的前提下,减少网络参数,SqueezeNet引入了1*1卷积,并通过将1*1卷积与3*3卷积做通道连接,来减少运算量[24]。MobileNet将标准卷积分解成深度卷积(Depthwise Convolution)和逐点卷积(Pointwise Convolution),从而大幅度减少卷积层的时间复杂度与空间复杂度。同时,网络可通过设置膨胀系数(alpha)调整网络规模大小[25-26]。ShuffleNet利用分组卷积(Group Convolution)和通道随机混合(Channel Shuffle)来设计网络结构,同样达到了减少模型参数量的目的[27]。

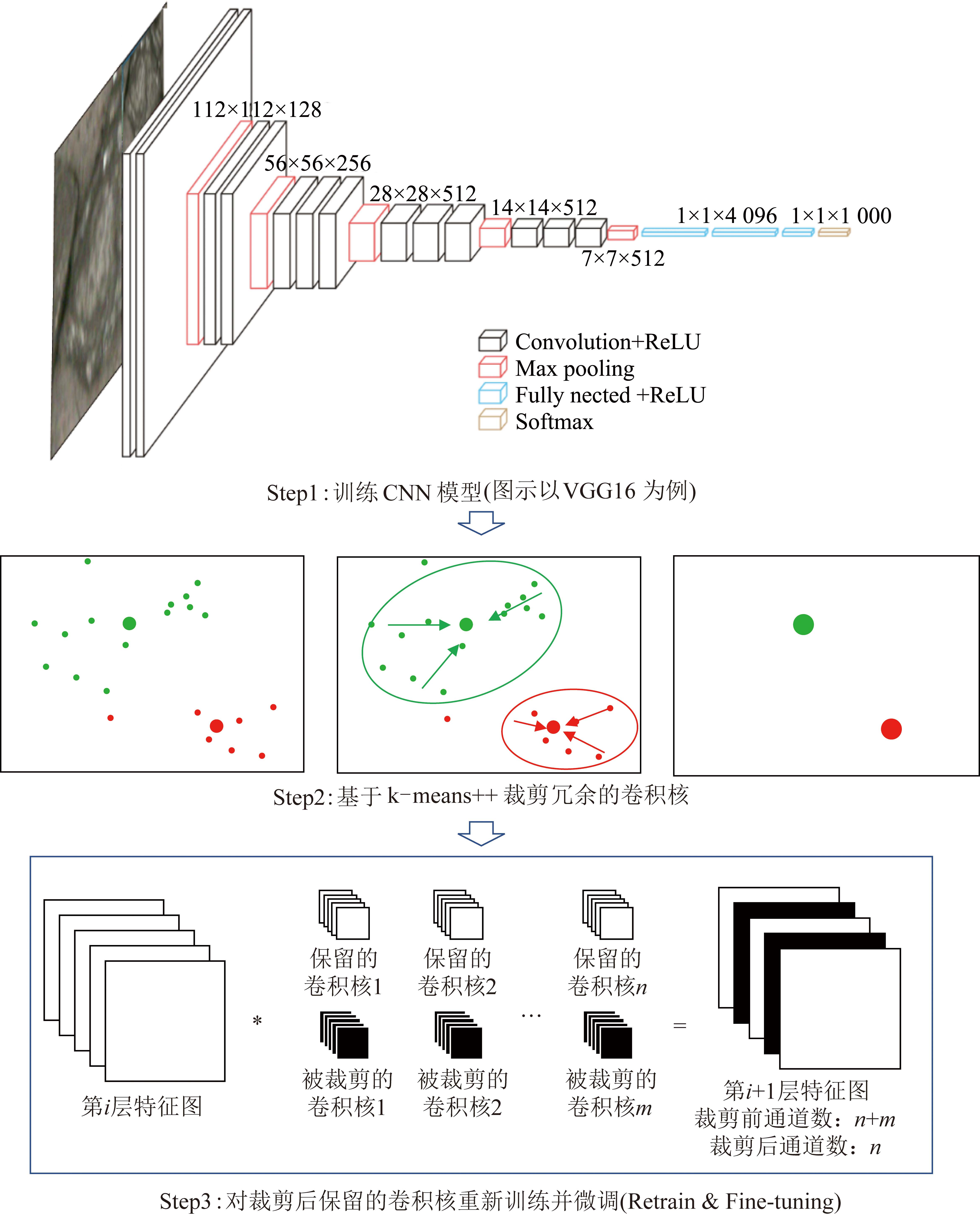

与直接设计更高效简洁的神经网络结构不同,模型剪枝是在已训练好的CNN模型上,通过特定的权重(即卷积核参数)评价标准,来判断权重的重要程度,将不重要的部分进行裁剪从而减少模型的冗余。但权重重要性的评价标准较难统一,依据重要性进行裁剪所得到的模型效果也不稳定。因此,笔者基于k-means++算法[28]分析不同卷积核所提取特征的相似程度,并以此作为判别依据进行裁剪,从而减少网络参数,达到轻量化的目的。煤矸识别模型的剪枝流程如下:

(1)利用现场采集的煤矸图像组成样本集,基于经典CNN框架训练煤矸识别模型;

(2)基于k-means++算法,由煤矸识别模型中的卷积核自动确定k个聚类中心,并依据聚类中心最短距离原则,计算各卷积核所属的聚类簇。保留距离聚类中心最近的卷积核,裁剪掉其余卷积核;

(3)在裁剪后模型的权重参数基础上,重新训练网络参数,弥补因模型剪枝影响而损失的识别精度。

研究CNN对煤与矸石图像自动提取到的特征,有利于理解CNN的作用机制,进一步优化模型,同时对于研究煤的表面特征也具有重要意义。常用的可视化方法主要为以下2种:

(1)激活层输出的可视化(Visualizing Intermediate Convnet Outputs),即可视化卷积核在激活之后的结果,从而看到图像经过每一层后所保留的内容,希望能够理解卷积核的作用;

(2)分类热力图的可视化(Visualizing Heatmaps of Class Activation in an Image),即利用热力图的形式来查看图像中不同类别的激活情况,希望了解图像中的哪一部分让CNN做出了最终的分类决策。

图4 煤矸识别模型的剪枝流程示意

Fig.4 Illustration of pruning method of coal and gangue recognition model

实验装置主要分为图像采集单元,数据运算单元,分拣控制单元与分拣执行单元4个部分。图像采集单元中的辅助光源由24根8 W的条状LED灯带组成,通过TracePro模拟计算光场情况后确定灯带分布,最终将识别区域内的照度稳定在1 200(±100)Lux。图像采集机构采用德国Basler公司的acA4096-40型工业相机,分辨率为4 096×2 168,拍摄速度为42 fps/s。数据运算单元为图像处理和识别的核心部分,分为模型训练服务器(CPU:Inter(R)Xeon CPU E5-2683 v3;GPU:NVIDIA Tesla K40c×2)与在线识别服务器(CPU:Inter(R)Core(TM)i5-9600 K;GPU:NVIDIA TITAN XP×1)。分拣控制单元由三菱PLC(Q04UDVCPU)和相关驱动器组成。分拣执行单元为独立设计的机械手,通过接收前端PLC的控制信号来完成分拣工作。关于分拣的控制策略与机械手结构并不是本文重点,笔者将另文介绍。实验中的图像采集装置如图5所示。

图5 图像采集装置

Fig.5 Image collection device

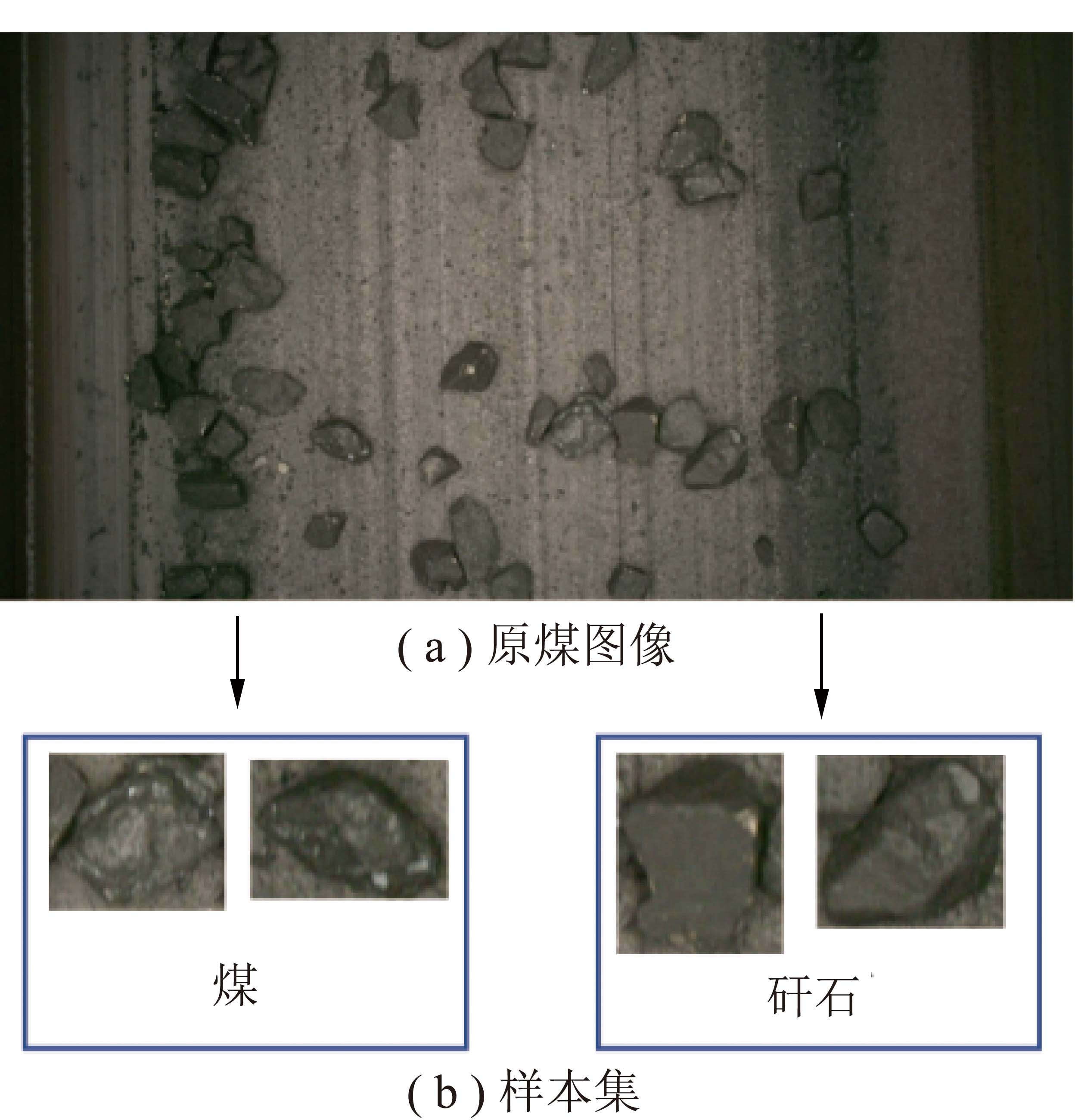

实验在中国安徽省涡阳县的涡北选煤厂进行。该选煤厂为中央选煤厂,入洗的原煤来自淮北矿业集团下属的多个矿区,包括焦煤,肥煤等多个煤种。原煤通过分级,大于50 mm的筛上物进入速度为0.5 m/s分选胶带。通过实验装置采集运输胶带上的原煤图像共13 251张,如图6(a)所示。经过人工标注和统计,平均每张原煤图像包含物料40余块,所有原煤图像中总计包括煤9 843块,矸石525 464块。由于选煤厂工艺流程问题,实验装置所在分选胶带上的物料,煤含量仅有5%~10%,采集到的原始样本集存在严重的类别不平衡问题。类别不平衡问题会对分类算法的学习过程造成严重的干扰[29]。笔者通过欠采样方式,将物料的部分从原煤图像中裁剪下来后,在煤样本中筛除部分图像质量较差的数据,保留9 500块煤样本(即9 500张煤图像);在矸石样本中随机取9 500块(即9 500张矸石图像),两类图像经过预处理作为本次实验的训练与测试样本集(共计19 000张煤矸石图像),如图6(b)所示。

图6 图像样本集

Fig.6 Image samples

(1)F1分数。

F1分数是统计学中用来衡量二分类模型性能的一种指标,是分类模型准确率P和召回率R的调和平均数。计算式为

![]()

(2)

![]()

(3)

![]()

(4)

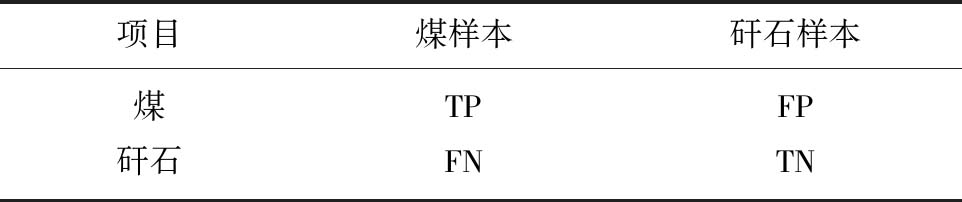

其中,当待测样本的预测结果与真实标签均为煤时记作TP(True Positive);当待测样本的预测结果为煤,但真实标签为矸石时记作FP(False Positive);当待测样本的预测结果与真实标签均为矸石时记作TN(True Negative);当待测样本的预测结果为矸石,但真实标签为煤时记作FN(False Negative)。样本真值与模型预测值关系见表1。

表1 预测值与真值关系

Table 1 Relationship between predicted value and true value

项目煤样本矸石样本煤TPFP矸石FNTN

(2)浮点运算数。

浮点运算数(Floating Point Operations,FLOPs),指计算量大小,常被用来衡量算法/模型的复杂度。目前,学术与工业界关于FLOPs的计算方式略有差异,本文中计算网络FLOPs采用的具体计算式[30]为

FLOPsConv=2HW(CinK2+1)Cout

(5)

FLOPsFc=(2I-1)O

(6)

式中,H,W,Cin分别为输入特征图的高、宽和通道数;K2为卷积核的尺寸;Cout为输出特征图的通道数;I为输入的维度数量;O为输出的维度数量。

(3)网络参数量。

网络参数量(Parameters)是指CNN中需要计算更新的参数量,用来衡量网络的规模大小,与模型最终所占的物理内存空间成正比,所以笔者直接采用最终训练得到的模型文件大小(Model size)进行比较。

为了更准确的评价模型效果,同时采用上述3种指标进行对比,F1越高说明模型的识别效果越好,FLOPs越低说明模型运算复杂度越小,Model size越小说明模型所占的内存空间越小,即网络规模越小。

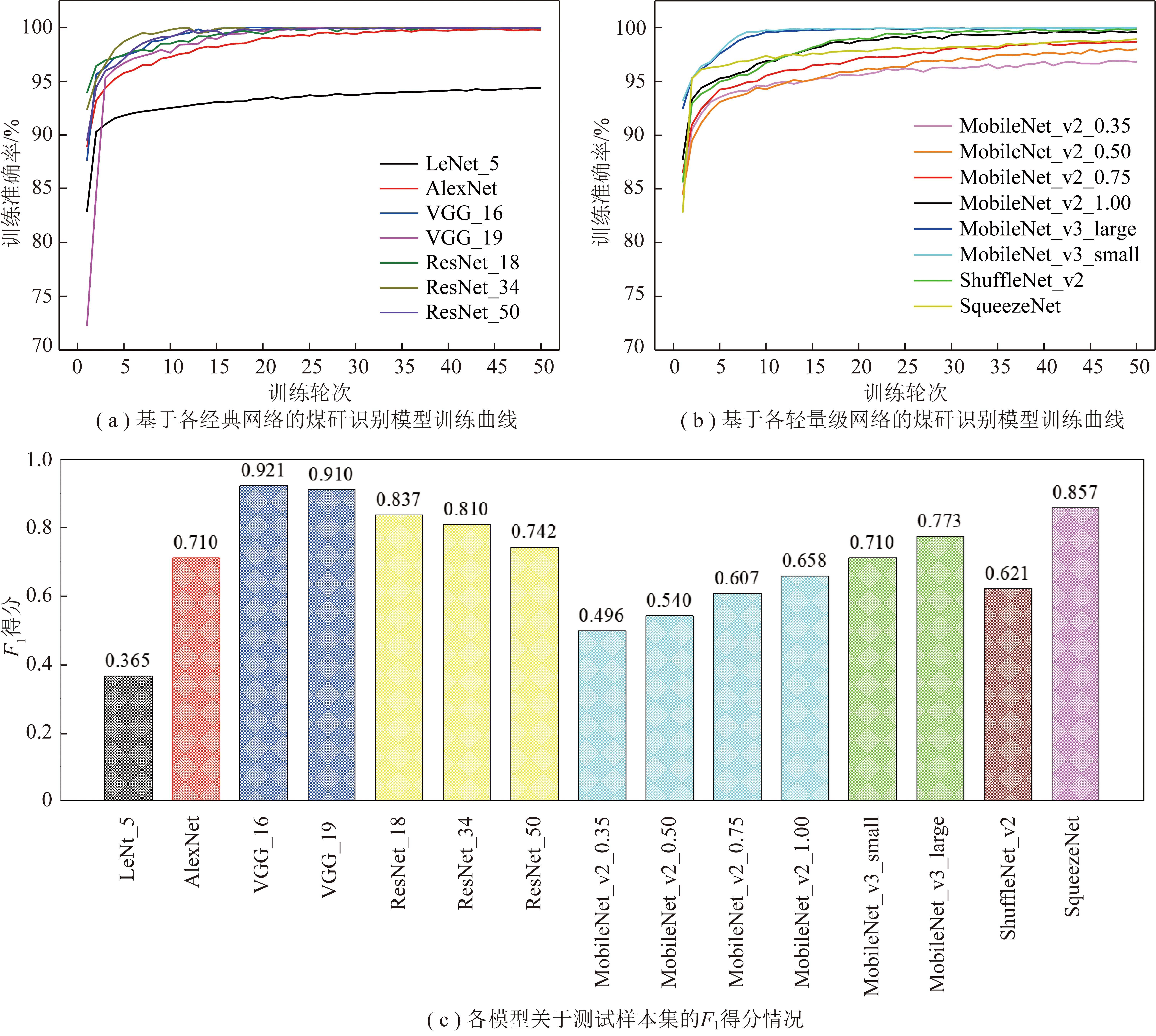

基于1.2节所述的几种经典网络框架与轻量级网络框架建立煤矸识别模型,得到的训练准确率曲线,如图7(a),(b)所示。从7(a),(b)可以看出,基于LeNet_5网络构建的模型收敛较差,训练准确率达到93%附近后趋于稳定。MobileNet_v2模型在α=0.35时,训练准确率最终稳定在95%附近,且随着alpha值增加,模型能收敛到的训练准确率也在逐渐增加。SqueezeNet模型与α=0.75时的MobileNet_v2模型的最终收敛值较为接近,但前者的收敛速度明显更快,仅需要3个训练轮次便有很好的收敛效果。其余模型训练收敛情况大致相同,均在10个训练轮次以内将train accuracy收敛至98%以上。

图7 基于不同CNN的煤矸识别模型对比

Fig.7 Comparison of coal gangue recognition models based on different CNNs

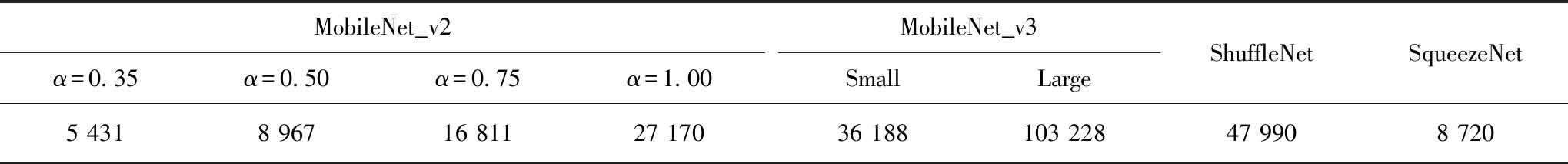

为了验证上述模型对现场煤矸样本的实际识别效果,由人工采集并核实100块煤与100块矸石构成测试样本集,对上述模型进行测试,各模型的F1得分情况如图7(c)所示。结果表明,在各模型中,基于VGG系列网络建立的煤矸识别模型测试结果最优(F1=0.921),基于LeNet_5网络建立的模型测试效果最差(F1=0.365),但总体上,除LeNet_5网络模型外,基于经典网络构建的煤矸识别模型的测试情况(F1_average=0.822)优于轻量级模型测试情况(F1_average=0.658),但在模型所占的存储空间方面(表2,3),轻量级模型平均大小为31 813 kb,仅为经典模型大小(605 592 kb)的5.25%。所以,轻量级模型与经典模型相比,计算资源的利用效率明显更高,各模型中,SqueezeNet模型的综合性能最佳,F1=0.857,而模型大小仅为8 720 kb。

另一方面,VGG系列与ResNet系列模型的模型复杂度高于LeNet_5和AlexNet,其测试结果也明显占优,但从VGG_16到ResNet_50,其模型复杂度与测试得分呈明显的负相关。在轻量级模型中也有相同的现象,MobileNet_v2模型测试得分与膨胀系数呈正相关,MobileNet_v3的large版本得分也高于small版本,但ShuffleNet模型复杂度高于SqueezeNet,其F1得分却为0.621。

上述情况说明,识别在现场采集到的煤与矸石图像,需要网络具有一定的深度与复杂度,这样有助于模型训练时的收敛与实际测试时的泛化。同时,过于复杂的网络结构会加重模型的过拟合情况,导致模型对训练样本的拟合度高,但实测效果差。所以确定合适的网络复杂度,是建立高效煤矸识别网络的关键。在本文所建立的煤矸识别模型中,VGG_16模型识别精度最高,但综合考虑模型占用的计算资源与取得的识别精度,SqueezeNet模型性能最佳。

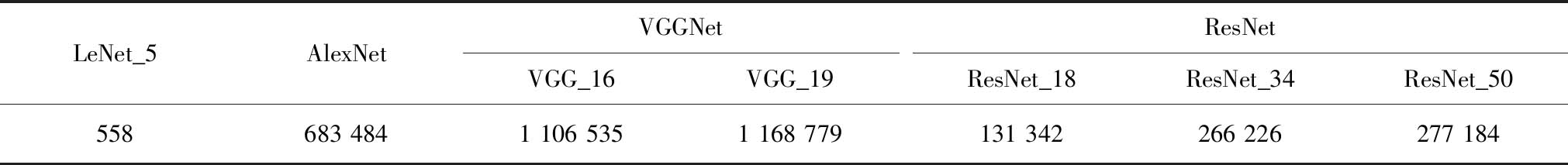

表2 经典模型所占内存大小

Table 2 Memory size of classical model kb

LeNet_5AlexNetVGGNetVGG_16VGG_19ResNetResNet_18ResNet_34ResNet_50558683 4841 106 5351 168 779131 342266 226277 184

表3 轻量级模型所占内存大小

Table 3 Memory size of lightweight model kb

MobileNet_v2α=0.35α=0.50α=0.75α=1.00MobileNet_v3SmallLargeShuffleNetSqueezeNet5 4318 96716 81127 17036 188103 22847 9908 720

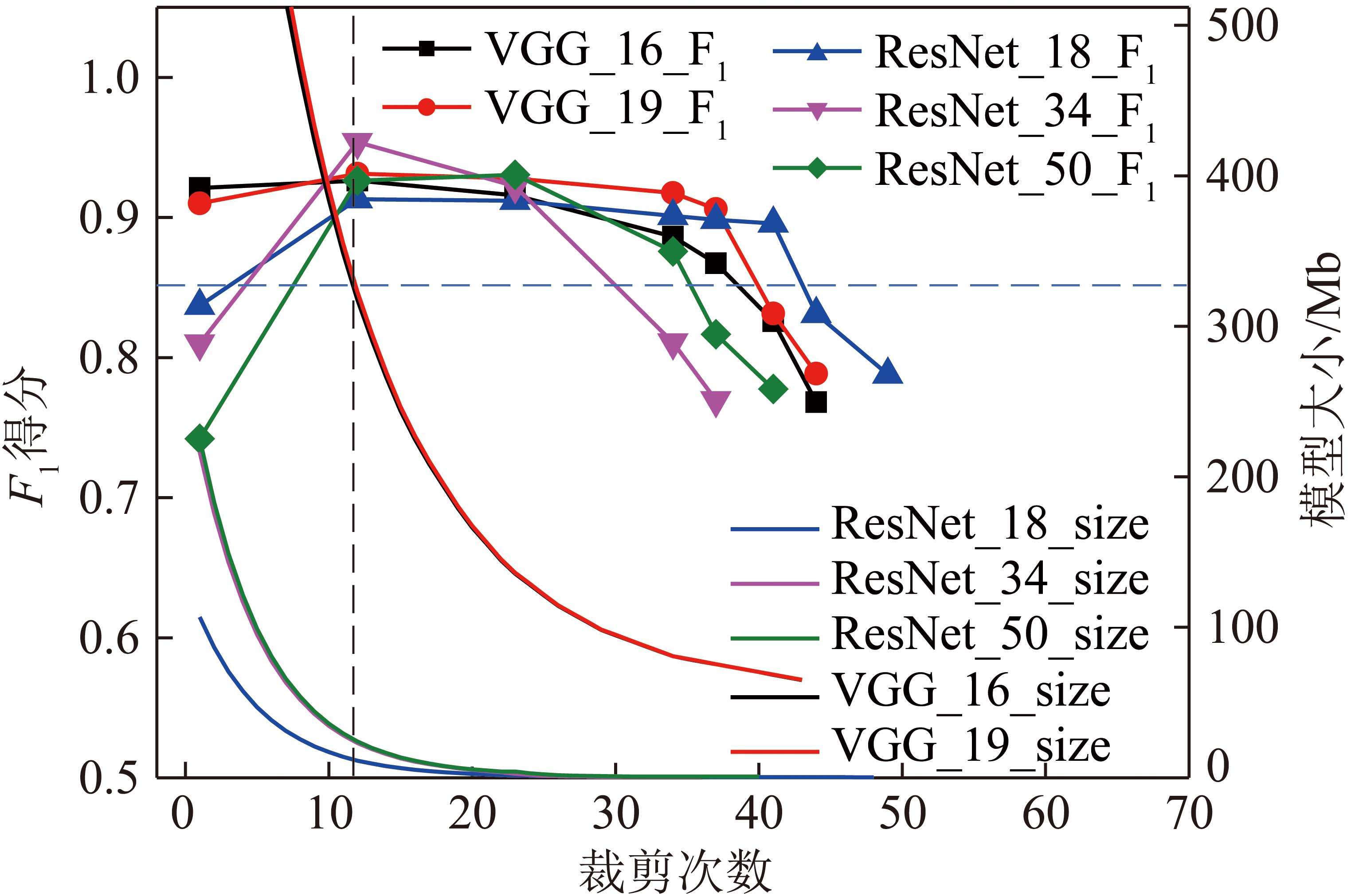

为验证本文1.3节所述模型剪枝方法的效果,选择3.1节中部分基于经典网络建立的煤矸识别模型(VGG_16,VGG_19,ResNet_18,ResNet_34,ResNet_50共5种)作为剪枝的基础模型。为测试每个基础模型的剪枝比例与识别精度变化的关系,对模型进行多轮次剪枝,结果如图8所示。

图8 剪枝过程中模型大小与测试精度的情况

Fig.8 Model size and F1 score during pruning

由图8可知,ResNet系列模型裁剪初期的裁剪效率较高,而在第12次裁剪后效率降低;VGG系列模型则在第25次裁剪后裁剪效率降低。裁剪效率的差异是由两系列模型的结构特点导致的,但共同点是所有模型在前12次裁剪中,对测试样本集的F1得分均有不同程度的提升,特别是ResNet系列模型得分的平均涨幅超过了17%,ResNet_34模型在第12次裁剪后,F1得分提升至0.954。这说明ResNet系列模型的参数冗余影响了模型对测试样本集的识别精度。随着裁剪次数的进一步增加,在第12次裁剪后,各模型的F1得分逐渐呈下降趋势,当裁剪至每个模型的裁剪上限时,各模型F1得分稳定在0.75附近,这是由于过量的裁剪会对模型精度产生负面作用。上述情况说明,建立煤矸识别模型应合理控制模型的规模,过于复杂的结构会导致模型参数的冗余与过拟合,结构过于简单又会使模型对样本特征的提取能力不足,导致欠拟合。该结论也与本文3.1节中分析模型训练情况所得到的结论一致。

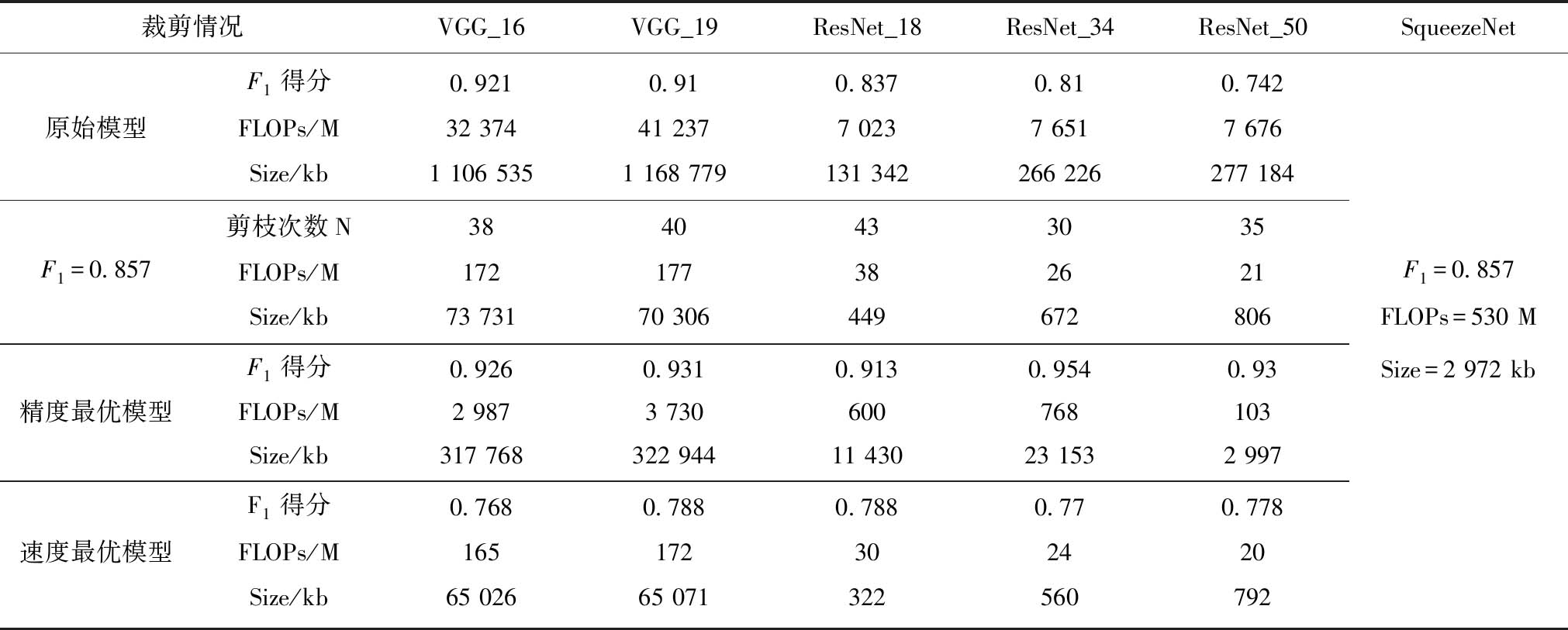

根据2.3节所述FLOPs计算方法,对经典网络的原始模型、精度最优模型、速度最优模型和第N次裁剪后模型的运算速度进行测试,结果见表4。其中,SqueezeNet模型是轻量级模型中测试效果最优的模型,其FLOPs值为530 M,F1得分为0.857,因此以F1=0.857为标准来确定N值,计算同等识别精度条件下各剪枝模型的复杂度。由表4可知,基于模型剪枝对已有煤矸识别模型进行裁剪,可得到比现有轻量级网络更高效的模型,且ResNet裁剪得到的模型更为轻便,约为同等精度下VGG裁剪后模型复杂度的12%~22%,其中ResNet_50裁剪后计算量为20 MFLOPs,已满足常规嵌入式设备需求;ResNet_34模型在经过12次裁剪后F1=0.954,较裁剪前提升了17.8%,得分高于实验中的所有模型,且FLOPs仅为768 M,Size为23 153 kb,模型计算量与模型大小均减少10倍。

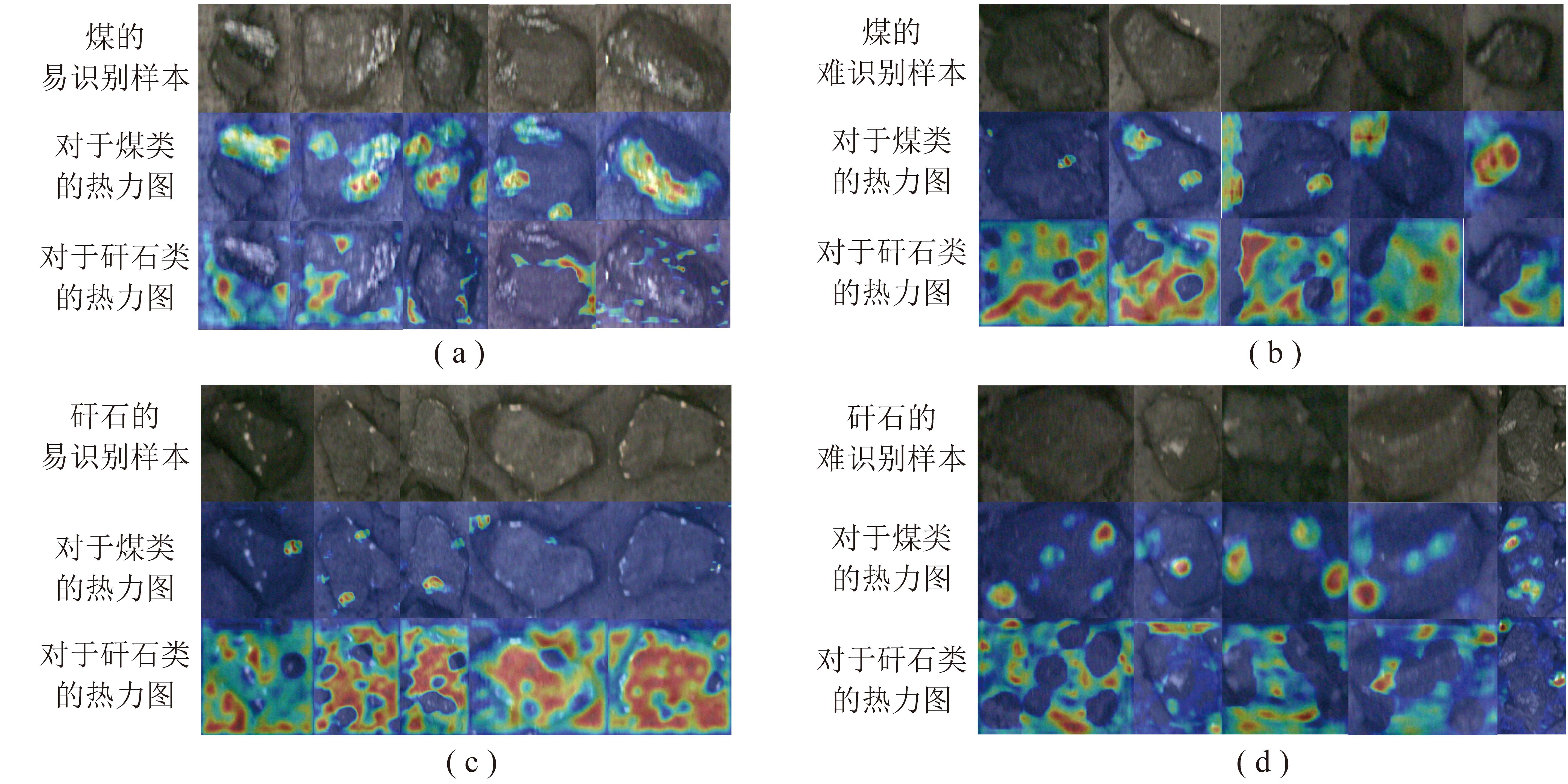

为探究裁剪后煤矸识别模型的分类依据,根据本文1.4节中所述分类热力图的可视化方法,对第12次裁剪后的ResNet_34模型进行可视化分析。可视化分析所需要的煤矸样本由测试样本集中各样本在模型剪枝过程中测试的累计错误次数决定。根据累计错误次数,将测试样本分为煤的易识别样本、煤的难识别样本、矸石的易识别样本和矸石的难识别样本4类,各5张。模型对各类样本的分类热力图如图9所示。结合图9(a),(c)可以发现,在煤类别中,激活程度高的部分多数为表面上因碰撞产生的截断面,而矸石类别中,表面完好平整的部分更容易被激活。对于煤表面的截断处,直观上普遍“黑且亮”,这是由于煤的显微组分中含有大量的镜质组成分,镜质组成分反光导致煤表面亮度变化剧烈。而矸石硬度大,轮廓棱角分明,表面普遍平整且截断面少。分析图9(b),(d)可以发现,煤与矸石的难识别样本从外观上看表面特征不明显,其中煤的难识别样本截断面较少,CNN依然可以捕捉到部分弱反光处,但更多平整灰暗处的表面被误认为是矸石特征;矸石的难识别样本相比易识别样本,轮廓并不明显,且光线较暗,画面整体激活度低。

表4 模型剪枝效果对比

Table 4 Comparison of model pruning effects

裁剪情况VGG_16VGG_19ResNet_18ResNet_34ResNet_50SqueezeNetF1得分0.9210.910.8370.810.742原始模型FLOPs/M32 37441 2377 0237 6517 676Size/kb1 106 5351 168 779131 342266 226277 184剪枝次数N3840433035F1=0.857FLOPs/M172177382621F1=0.857Size/kb73 73170 306449672806FLOPs=530 MF1得分0.9260.9310.9130.9540.93Size=2 972 kb精度最优模型FLOPs/M2 9873 730600768103Size/kb317 768322 94411 43023 1532 997F1得分0.7680.7880.7880.770.778速度最优模型FLOPs/M165172302420Size/kb65 02665 071322560792

图9 分类热力图的可视化

Fig.9 Visualizing heatmaps of class activation in an image

根据上述结果,可以认为基于本文方法建立并优化后的煤矸识别模型可以准确捕捉到煤与矸石截断面处的差异,结合物料的轮廓和表面平整程度,综合给出识别结果。上述特征在煤与矸石之间的差异,本质是由于两者硬度不同。在原煤的运输与筛分过程中,物料不可避免的发生碰撞,使得煤与矸石的硬度差异体现为表面特征的差异。文献[31]中利用传统图像处理的方法分析煤与矸石截断面处的特征值,最终认为由煤与矸石硬度不同造成的纹理差异,特别是截断面处的特征差异更为明显,以此为依据进行分类也更可靠。上述结论与本文的实验结果相一致。所以,CNN自动提取显著特征并分类的方式与人类视觉的作用机制相同,基于CNN建立的煤矸识别模型可以捕捉到煤与矸石由于硬度不同而产生的表面差异,以此减轻因煤泥附着而产生的对特征提取的干扰。特别是在煤的截断面处,因镜质组成分而产生的反光可以作为识别煤的可靠依据。

(1)基于深度卷积神经网络建立了煤矸识别模型,分析了多种网络框架下模型的训练与测试情况,结果表明建模使用的网络结构不可过于复杂,应在保证特征提取能力的同时减少过拟合;在各网络中,VGG16对煤矸图像的识别精度最高但效率低,SqueezeNet综合能力最优。

(2)基于模型剪枝对已训练的CNN模型进行了优化,实现了提高识别精度的同时减少计算与存储资源占用量,提高网络效率,最终优化后的煤矸识别模型F1=0.954,Size=23 153 kb,FLOPs=768 M。

(3)基于热力图可视化分析了模型剪枝后最优煤矸识别模型的分类依据。实验结果发现,本文所训练的CNN更倾向于捕捉煤与矸石由于硬度不同产生的轮廓、纹理等表面差异,在煤的截断面处因镜质组成分而产生的反光可以作为识别煤的可靠依据。

[1] REN Y,LI R,GAO H,et al.Research on the evaluation model and suggestions of coal resources mining level in China[J].IOP Conference Series Earth and Environmental Science,2018,170(2):022064.

[2] ZHAO Y,HE X.Recognition of coal and gangue based on X-Ray[J].Applied Mechanics and Materials,2013,275-277:2350-2353.

[3] WANG W,ZHANG C.Separating coal and gangue using three-dimensional laser scanning[J].International Journal of Mineral Processing,2017,169:79-84.

[4] MCCOY J T,AURET L.Machine learning applications in minerals processing:A review[J].Minerals Engineering,2019,132:95-109.

[5] HEYDUK A,JOOSTBERENS J,NOWROT A,et al.Image histogram as a tool for a coal stream homogeneity evaluation[A].IOP Conference Series:Materials Science and Engineering[C].IOP Publishing,2018,427(1):012023.

[6] TRIPATHY D P,REDDY K G R.Novel methods for separation of gangue from limestone and coal using multispectral and joint color-texture features[J].Journal of the Institution of Engineers(India):Series D,2017,98(1):109-117.

[7] 于国防.煤矸区分中的间隔灰度压缩扩阶共生矩阵[J].中国图象图形学报,2012(8):77-81.

YU Guofang.Interval grayscale compression and expansion co-occurrence matrix in coal gangue discrimination[J].Journal of Image and Graphics,2012(8):77-81.

[8] 陈雪梅,张晞,徐莉莉,等.煤与矸石分形维数的差异研究[J].煤炭科学技术,2017,45(7):196-199.

CHEN Xuemei,ZHANG Yan,XU Lili,et al.Study on the difference of fractal dimension between coal and gangue[J].Coal Science and Technology,2017,45(7):196-199.

[9] LI W,WANG Y,FU B,et al.Coal and coal gangue separation based on computer vision[A].2010 Fifth International Conference on Frontier of Computer Science and Technology[C].IEEE,2010:467-472.

[10] HOU W.Identification of coal and gangue by feed-forward neural network based on data analysis[J].International Journal of Coal Preparation and Utilization,2019,39(1):33-43.

[11] ZHENG K,DU C,YANG D.Orthogonal test and support vector machine applied to influence factors of coal and gangue separation[J].International Journal of Coal Preparation and Utilization,2014,34(2):75-84.

[12] WANG W,LV Z,LU H.Research on methods to differentiate coal and gangue using image processing and a support vector machine[J].International Journal of Coal Preparation and Utilization,2018:1-14.

[13] KRIZHEVSKY A,SUTSKEVER I,HINTON G E.Imagenet classification with deep convolutional neural networks[A].Advances in Neural Information Processing Systems[C].2012:1097-1105.

[14] PU Y,APEL D B,SZMIGIEL A,et al.Image recognition of coal and coal gangue using a convolutional neural network and transfer learning[J].Energies,2019,12(9):1735.

[15] SU L,CAO X,MA H,et al.Research on coal gangue identification by using convolutional neural network[A].2nd IEEE Advanced Information Management,Communicates,Electronic and Automation Control Conference(IMCEC)[C].IEEE,2018:810-814.

[16] DOU D,ZHOU D,YANG J,et al.Coal and gangue recognition under four operating conditions by using image analysis and Relief-SVM[J].International Journal of Coal Preparation and Utilization,2018:1-10.

[17] 王家臣,李良晖,杨胜利.不同照度下煤矸图像灰度及纹理特征提取的实验研究[J].煤炭学报,2018,43(11):105-115.

WANG Jiachen,LI Lianghui,YANG Shengli.Experimental research on gray and texture feature extraction of coal gangue images under different illumination[J].Journal of China Coal Society,2018,43(11):105-115.

[18] HAN S,POOL J,TRAN J,et al.Learning both weights and connections for efficient neural network[A].Advances in Neural Information Processing Systems[C].2015:1135-1143.

[19] JACOB B,KLIGYS S,CHEN B,et al.Quantization and training of neural networks for efficient integer-arithmetic-only inference[A].Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition[C].2018:2704-2713.

[20] HINTON G,VINYALS O,DEAN J.Distilling the knowledge in a neural network[J].arXiv Preprint arXiv,2015,1503:02531.

[21] 周飞燕,金林鹏,董军.卷积神经网络研究综述[J].计算机学报,2017,40(6):1229-1251.

ZHOU Feiyan,JIN Linpeng,DONG Jun.Review of convolutional neural network research[J].Chinese Journal of Computers,2017,40(6):1229-1251.

[22] LECUN Y,BOTTOU L,BENGIO Y,et al.Gradient-based learning applied to document recognition[J].Proceedings of the IEEE,1998,86(11):2278-2324.

[23] SIMONYAN K,ZISSERMAN A.Very deep convolutional networks for large-scale image recognition[J].arXiv Preprint arXiv:2014,1409:1556.

[24] IANDOLA F N,HAN S,MOSKEWICZ M W,et al.SqueezeNet:AlexNet-level accuracy with 50x fewer parameters and< 0.5 MB model size[J].arXiv Preprint arXiv:2016,1602:07360.

[25] SANDLER M,HOWARD A,ZHU M,et al.Mobilenetv2:Inverted residuals and linear bottlenecks[A].Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition[C].2018:4510-4520.

[26] HOWARD A,SANDLER M,CHU G,et al.Searching for mobilenetv3[A].Proceedings of the IEEE International Conference on Computer Vision[C].2019:1314-1324.

[27] ZHANG X,ZHOU X,LIN M,et al.Shufflenet:An extremely efficient convolutional neural network for mobile devices[A].Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition[C].2018:6848-6856.

[28] ARTHUR D,VASSILVITSKII S.k-means++:The advantages of careful seeding[R].Stanford,2006.

[29] ZHANG M,CUI Z,WANG X,et al.Data Augmentation Method of SAR Image Dataset[A].IGARSS 2018-2018 IEEE International Geoscience and Remote Sensing Symposium[C].IEEE,2018:5292-5295.

[30] MOLCHANOV P,TYREE S,KARRAS T,et al.Pruning convolutional neural networks for resource efficient inference[J].arXiv Preprint arXiv,2016,1611:06440.

[31] SUN Z,LU W,XUAN P,et al.Separation of gangue from coal based on supplementary texture by morphology[J].International Journal of Coal Preparation and Utilization,2019:1-17.